為了提升服務質素,我們會使用 Cookie 或其他類似技術來改善使用者的閱讀體驗。 如想了解更多請到 這裡 >。

KTransformers 計畫的核心技術在於 異質運算策略,透過以下關鍵技術降低顯存負擔:

稀疏矩陣優化(MoE 架構):僅啟動部分專家模組,並將非共享的稀疏矩陣卸載至 CPU 內存,大幅壓縮VRAM佔用至 24GB。

4bit 量化與算子優化:使用 Marlin GPU 算子,讓運算效率提升 3.87 倍,並透過 llamafile 多執行緒並行,將預處理速度提升至 286 tokens/s。

CUDA Graph 加速:減少 CPU/GPU 通訊延遲,單次解碼僅需 一次完整 CUDA Graph 調用,生成速度高達 14 tokens/s。

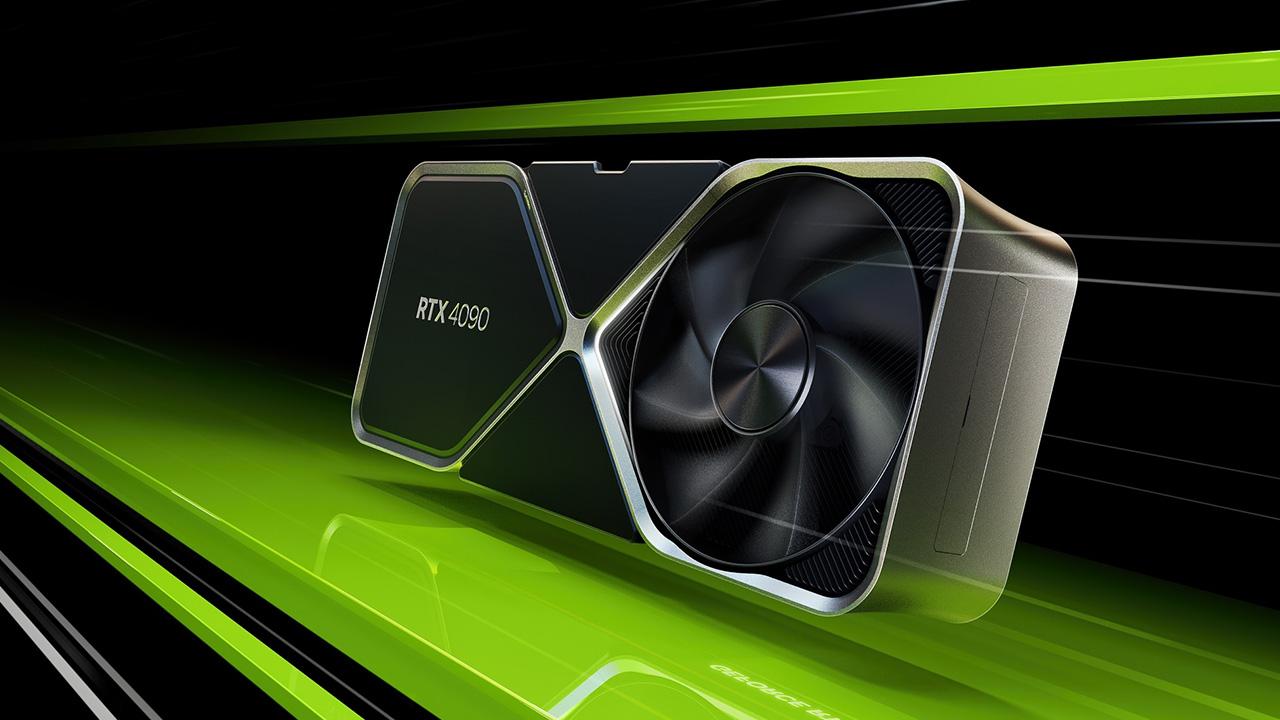

這項突破帶來的影響驚人!傳統 AI 訓練方案需要 8 張 A100 伺服器,成本超過百萬,雲端租用費用每小時高達 數千元。但 RTX 4090 單卡方案 讓這一切變得更親民:

整機成本:僅 約 2 萬元

功耗:僅 80W,大幅降低能耗

適用對象:中小型 AI 團隊、個人開發者

這次突破不只是 技術的勝利,更是 開源精神與硬體潛能的極致發揮,讓 AI 研究更具可及性,顛覆了傳統算力瓶頸!